이번 글에서는 로컬 시스템에 바이브코딩 개발 환경을 구축하는 과정을 다루어보겠습니다.

흔히 바이브코딩.. 이라고 하면 Cursor나 Anthropic의 Claude Code, OpenAI의 Codex, Github Copilot, google의 Gemini CLI 등을 떠올립니다.

그리고 저 도구들이 대세죠.

최근에는 저 도구들도 로컬 시스템의 모델을 설정할 수 있도록 지원하기 시작했다고 합니다만 그래도 유료 모델의 유료 API를 사용하는 것이 기본 설정으로 되어 있습니다.

저는 오직 로컬 시스템의 모델만을 이용한 환경을 구축하려고 합니다.

도무지 처리되지 않는 문제가 생긴다면 그 문제만큼은 유료 API를 사용해야 하겠지만 기본적으로 로컬 환경을 원합니다.

그래서 추천받은 도구가 Aider입니다.

그러고보니.. 블로그명(회사명)과 발음이 비슷하군요.

Aider는 Claude Code처럼 터미널 기반의 도구입니다.

유료 모델도 사용할 수 있지만 로컬 모델의 성지라고 불릴 정도로 Ollama와 같은 로컬 LLM 환경과 잘 호환되고 효율적으로 사용할 수 있다고 합니다.

또한 다양한 데이터나 프로젝트 코드, 정보 등이 로컬 시스템 안에서 처리되기때문에 보안 면에서 상당히 뛰어다다는 이유로 추천을 받았습니다.

특히 서로 지시와 요청을 주고받는 페어 프로그래밍으로서의 역할에 최적이라고 하는군요.

그리고 제가 주로 사용하는 IDE는 Visual Studio Code(VSCode)입니다.

VSCode에서 LLM 모델과 연동하여 바이브코딩을 하기 좋은 확장 플러그인으로 오픈소스이며 로컬 모델 연동에 최적화된 Continue.dev가 있더군요.

그래서 다음과 같은 구성을 하기로 했습니다.

최선의 로컬 바이브 코딩 스택 (Integrated Stack)

- 모델 엔진

- Ollama : 설치가 간편하고 리눅스 GPU 가속 최적화

- 추천 모델

- Qwen2.5-Coder-32B (Q4_K_M 양자화)

- 32GB RAM 환경에서 가장 추천하는 모델

- 코딩 실력이 GPT-4o에 근접하며 한국어 이해도가 매우 높음

- Qwen2.5-Coder-32B (Q4_K_M 양자화)

- VSCode 확장 도구

- Continue.dev : 오픈소스이며 로컬 모델 연동에 최적화됨

- 에이전트(CLI)

- Aider : 파일 전체를 수정하고 Git과 연동하는 '바이브 코딩'의 핵심 도구

그럼 구축 과정을 살펴보도록 하겠습니다.

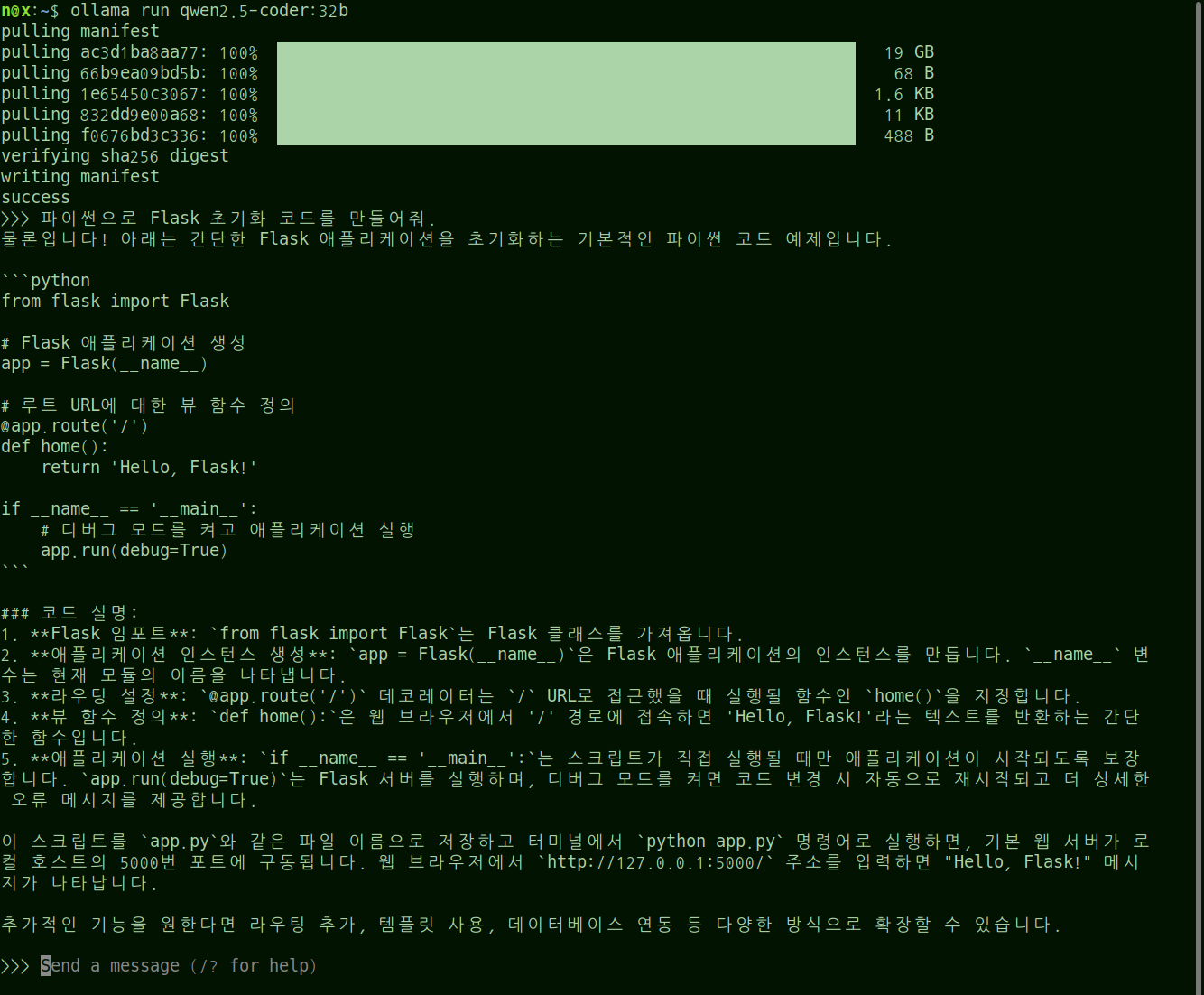

1단계: Ollama 설치 및 모델 최적화

1.1 리눅스 터미널에서 다음 명령어로 Ollama를 설치합니다.

curl -fsSL https://ollama.com/install.sh | sh

1.2 설치 후, 32GB RAM을 십분 활용하기 위해 32B 모델을 내려받습니다.

ollama run qwen2.5-coder:32b

(참고)

32B 모델은 약 19GB의 메모리를 점유합니다.

GPU VRAM이 부족하면 자동으로 시스템 RAM을 사용하므로 속도는 조금 느려지지만 정확도는 최상입니다.

약간 느린가.. 싶긴해도 그럭저럭 쓸만한 속도를 보여주고 있습니다.

조금 느긋하게 생각한다면 충분히 사용할 수 있을 것 같습니다.

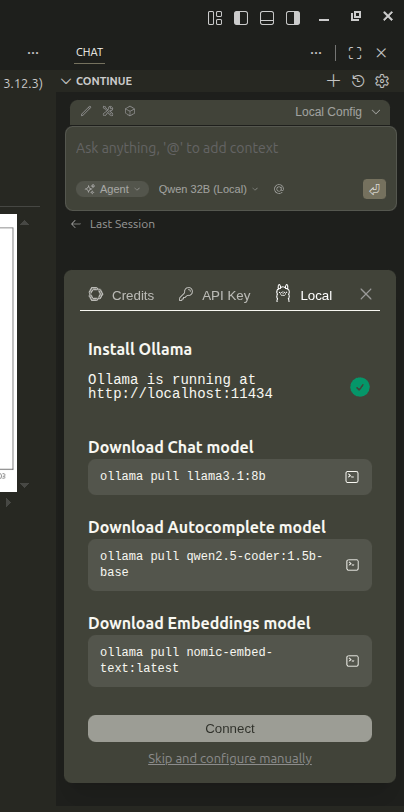

2단계: VSCode와 Continue 연동 (GUI 환경)

2.1 VSCode 마켓플레이스에서 Continue 확장을 설치합니다.

2.2 ~/.continue/config.yaml 설정을 열어 Ollama를 기본 모델로 지정합니다.

name: Local Config

version: 1.0.0

schema: v1

models:

- name: Qwen 32B (Local)

provider: ollama

model: qwen2.5-coder:32b

roles:

- chat

- edit

contextLength: 16384 # 32GB RAM 덕분에 코드 수천 줄을 한 번에 읽을 수 있음

# 코드 자동 완성(Tab-Autocomplete) 설정

tabAutocompleteModel:

name: Qwen 7B (Fast)

provider: ollama

model: qwen2.5-coder:7b

# 코드베이스 전체 검색(임베딩) 설정

embeddingsProvider:

provider: ollama

model: nomic-embed-text

# 바이브 코딩의 효율을 극대화해주는 설정. 단축키 등을 지원

slashCommands:

- name: edit

description: 선택한 코드를 수정하거나 새로운 코드를 작성함

- name: comment

description: 코드에 한글 주석을 상세히 달아줌

- name: fix

description: 선택한 코드의 버그를 찾고 해결책을 제시함

- name: test

description: 선택한 코드를 검증하기 위한 Unit Test를 작성함

- name: share

description: 현재 대화 내용을 마크다운으로 내보냄 (Handoff용)

slashCommands는 필수는 아니지만 다음과 같은 기능을 지원하여 바이브코딩의 효율을 극대화시키는 도구이므로 설정해 줄것을 권장합니다.

- 프롬프트 일관성

- /edit을 치면 Continue 내부적으로 "코드를 수정할 때는 이런 형식을 지켜라"라는 최적화된 지침이 모델(Qwen 32B)에 전달됨

- 직접 타이핑하는 것보다 훨씬 결과물이 정확함

- 맥락 보존

- /fix를 사용하면 현재 터미널의 에러 로그나 선택된 코드 영역을 AI가 더 집중해서 분석하게 됨

- 바이브 코딩의 리듬

- 코드를 드래그하고 Ctrl+I를 누른 뒤 /comment라고만 치면 Qwen이 즉시 한글 주석을 생성하기 시작함

3단계: Aider 설치 (에이전트 바이브 코딩의 핵심)

Aider는 터미널에서 실행되며, 로컬 모델이 내 소스코드 파일을 직접 읽고 수정하게 해줍니다.

pip install aider-chat

# Ollama와 연동하여 실행

aider --model ollama/qwen2.5-coder:32b

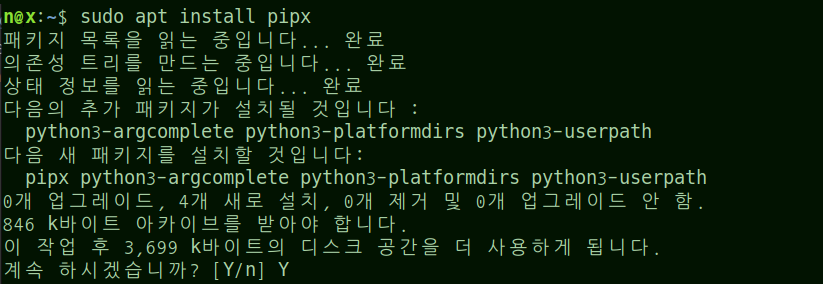

그런데 위의 방식은 가상환경마다 aider-chat을 설치하고 실행해야 한다는 단점이 있습니다.

Aider는 시스템 전역(Global) 혹은 독립된 전용 가상환경에 딱 한 번만 설치하고, 모든 프로젝트에서 끌어다 쓰는 방식이 가장 효율적입니다.

그래서 pipx를 사용할 것을 권장합니다.

sudo apt install pipx

pipx ensurepath

pipx install aider-chat

이렇게 하면 Aider는 자기만의 가상환경에 안전하게 설치되고, 사용자는 어느 폴더에서든 aider라고 입력하기만 하면 됩니다.

이제 Ollama - Local LLM - VSCode/Continue.dev - Aider 로 구성되는 라인이 완성되었습니다.

그럼 한 번 테스트를 해 보도록 합니다.

먼저 가상환경을 만들도록 하죠.

mkdir vibecoding

cd vibecoding

python -m venv .venv

source .venv/bin/activate

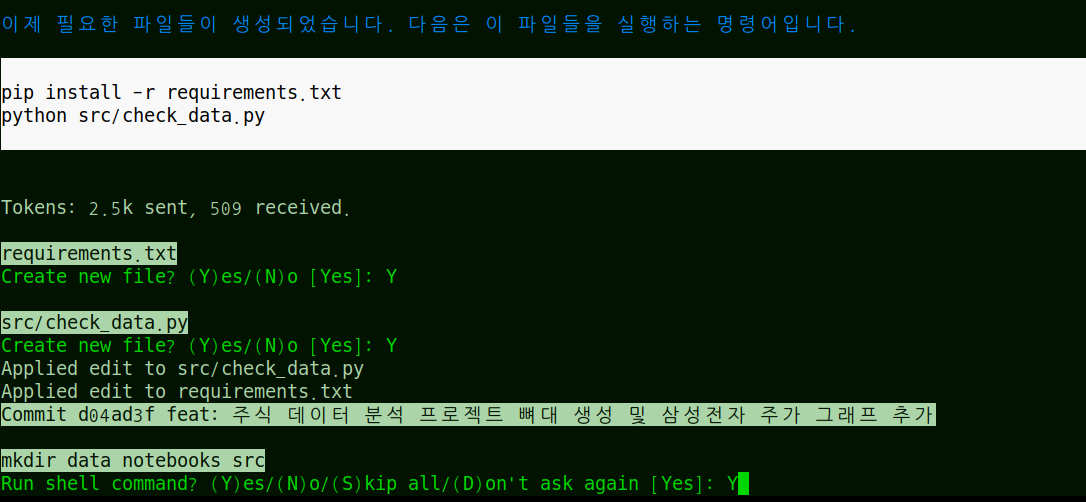

가상환경이 만들어졌으면 활성화 시킨 후, Qwen2.5-Coder:32B 모델을 적용시킨 Aider를 실행시킵니다.

그리고 작업을 지시해 봅시다.

aider --model ollama/qwen2.5-coder:32b

여기까지 해서... 로컬 시스템에서 바이브 코딩을 위한 환경을 구축하고 테스트를 진행해 보았습니다.

살짝 지연시간이 느껴지긴 하지만 큰 무리없이 작업이 진행됩니다.

그런데 최근 중국에서 만들어진 모델과 에이전트, 도구들에서 사용자의 정보가 중국 서버로 유출되는 것이 발견되었다거나.. 하는 불안한 소문이 많이 들려옵니다.

모델 자체는 단순히 학습된 가중치들만 포함되어 있고, 또 Ollama 등에서 확인한 모델들이라고 하지만 불안이 사라지지 않습니다.

그래서 다음 글에서는 이런 걱정을 불식시킬 수 있도록 Docker를 이용하여 격리된 환경을 구축해 보겠습니다.

Docker 컨테이너 안의 시스템은 호스트 시스템에서 허가받은 곳만 접근하고 볼 수 있도록 막아버리는 방법입니다.

그러면 중요한 정보들을 아예 보지 못하니까 혹시 모르는 위협이 있더라도 안전해 질 수 있겠죠.

그럼 다음 글에서 뵙겠습니다.

'AiDALab Project > Vibe Coding' 카테고리의 다른 글

| "프롬프트-컨텍스트-하네스"의 각 단계와 "바이브 코딩-에이전트 루프" (0) | 2026.04.03 |

|---|---|

| LLM에 대한 접근 방식의 변화 (0) | 2026.04.02 |

| 하네스 엔지니어링 (Harness Engineering) (0) | 2026.04.01 |

| 로컬 시스템으로 Vibe Coding을 시작하자 (1) (0) | 2026.03.01 |